Dans un monde qui génère un nombre de données à la croissance exponentielle, on peut s’attendre à ce que l’intelligence artificielle (IA) aide toujours mieux l’humain à anticiper les chocs stratégiques. Toutefois, du 11 septembre 2001 au 7 octobre 2023, malgré les progrès réalisés par les algorithmes d’IA pendant ces deux décennies, la machine n’a jamais pu fournir le moindre élément susceptible d’aider à prévoir ces terribles événements.

Par Jean-Baptiste Fantun

Article paru dans le numéro 50 de mars 2024 – Sahel. Le temps des transitions.

Nous tenterons de démontrer ici que les causes de ces échecs successifs ne proviennent pas d’une incapacité congénitale de l’IA à fournir des outils d’anticipation, mais d’une focalisation trop exclusive sur un certain type d’algorithme. À l’inverse, NukkAI (start-up dont nous reparlons plus bas) propose une IA de nouvelle génération qui apporte, en lien étroit avec les experts du domaine, une solution innovante au défi de l’anticipation.

Qu’est-ce que l’IA ?

En guise de préambule, définissons l’intelligence artificielle comme la capacité pour la machine d’accomplir des tâches habituellement réservées aux humains, comme :

- Apprentissage : un enfant découvre le monde et à partir d’exemples (induction), apprend à distinguer un chat d’un chien, etc.

- Planification : un couple prépare ses vacances en prenant en compte ses contraintes (dates), ses préférences, etc.

- Fusion de données : un enquêteur croise des informations issues de diverses sources pour procéder à des déductions.

- Création : un artiste imagine et produit un tableau, un texte, etc.

Constatons que l’apprentissage (premier exemple) à partir de données (appelé parfois big data si le volume de données est conséquent) n’est qu’un paradigme d’IA (la méthode la plus connue dans ce domaine est celle du deep learning) parmi plusieurs autres. Le problème est que dans la dernière décennie, tous les projecteurs ont été tournés vers ce type spécifique d’IA fondée sur les données. Cela, pour des raisons à la fois techniques et politiques.

Techniques, car les méthodes de deep learning furent les premières à passer à l’échelle en bénéficiant de l’immense progrès réalisé par les microprocesseurs.

Politiques, car les Gafam, tous américains, ont expliqué au monde entier que, hors du big data, point de salut. Ce, pour cette raison simple qu’ils possèdent, eux, les data et ont recruté les plus grands experts de cette IA des données (le Français Yann Le Cun, prix Turing, dirige la recherche de Meta). Concentrant à la fois les données et le savoir-faire en IA des données, ils disent au reste du monde : « Arrêtez de faire de la recherche en IA, vous ne nous rattraperez pas, achetez plutôt nos produits. » Et, dans un élan de soumission et d’ignorance, nous gobons ce discours en réduisant l’IA à l’IA des données.

Pourtant, quand on revient aux questions d’anticipation dans les domaines de la sécurité, de la géopolitique, rien de concluant n’est jamais issu du big data. Déverser dans un entonnoir toutes les données et demander à la machine, presque en toute autonomie, de rechercher l’aiguille dans la botte de foin, n’a jamais fonctionné jusqu’ici. Voici quelques années on eut PredPol, projet pharaonique de police prédictive. La police de Los Angeles y dépensa des fortunes, pour arriver à des prévisions équivalant à « il y aura une vente de cigarettes à la sauvette au métro Barbès cet après-midi » ; pratique décrite par d’ironiques policiers de terrain comme « la prédiction des banalités »…

Nous avons évoqué plus tôt le 7 octobre 2023 : Gaza est la zone du globe qui remonte le plus de data au m2 et il est sûr que quelque part dans l’amas de données à la disposition des services de sécurité israéliens, existaient tous les éléments qui, mis bout à bout, auraient permis d’anticiper le drame du 7 octobre. Il manquait justement une intelligence de déduction pour connect the dots et alerter les responsables en cause ; rien à voir avec le deep learning. Ainsi, le projet de machines qui tirent la substantifique moelle de milliards de données sans l’expert, pour les guider et interagir avec elles, montre de façon récurrente ses limites.

A lire aussi

Podcast : intelligence artificielle; Pascal Boniface

Les limites de la machine

Face à cette hystérie autour de l’IA des données, une start-up française, NukkAI, s’est élevée dès 2018 pour faire entendre une voix dissonante, car le monopole du deep learning lui semblait présenter des dangers et des limites : faible collaboration avec l’humain, manque de transparence et caractère datavore – donc énergivore – peu soutenable dans la durée. NukkAI s’est lancée avec l’objectif de créer une IA de nouvelle génération, qui collabore avec l’humain, soit explicable et frugale en données. Son credo : « Tout comme l’humain possède plusieurs types d’intelligence, la machine doit mobiliser simultanément plusieurs types d’intelligence artificielle ». Une IA hybride, en somme.

Démarche classique dans le monde de l’IA, NukkAI a choisi un jeu pour tester son IA : le bridge. Jeu à la fois contradictoire et collaboratif, à information incomplète : sa complexité faisait de lui la « dernière frontière de l’IA », le dernier jeu où l’humain restait plus fort que la machine puisque les échecs et le go étaient « tombés ». Pourtant, en mars 2022, NukkAI a invité à Paris huit champions de bridge à se mesurer à son IA « Nook »… et Nook a gagné ses huit matchs.

Un tel exploit tient au fait que Nook, contrairement à ses prédécesseurs joueurs d’échecs ou de go, utilise plusieurs intelligences, dont l’expertise humaine. Cela pour économiser des ressources précieuses : entraîné sur Jean Zay, le supercalculateur du CNRS, Nook a consommé 200 000 fois moins de ressources qu’AlphaGo, robot de go développé par Google DeepMind ! De surcroît, Nook sait expliquer ses décisions, ce qui le rend précieux aux yeux des experts de bridge.

Retour à la vie réelle, Nook a vite pu être adapté à des problèmes d’une grande complexité combinatoire comme la planification des opérations de compagnies aériennes ou la replanification coordonnée en temps réel de flottes de bateaux en cas de catastrophe climatique.

Plusieurs compagnies aériennes ont ainsi confié à NukkAI l’élaboration de leur planning de rotations d’avions et l’affectation des personnels navigants à chaque rotation. Ce processus d’une grande complexité qui, avec des algorithmes classiques, nécessitait un effort d’une quinzaine de jours sans garantie d’optimalité, est aujourd’hui exécuté en dix minutes et aboutit à la proposition par la machine de plusieurs scénarios parmi lesquels les opérationnels choisissent, car il y a plusieurs paramètres à optimiser simultanément : la densité des rotations, la satisfaction du personnel, etc. L’IA de NukkAI révolutionne le domaine des transports, son premier champ d’application, et ce n’est qu’un début, car des applications sont possibles dans la santé ou la finance.

IA et sécurité

Dans le domaine sécurité-défense, NukkAI et Xavier Raufer collaboraient dès 2019 à un projet exploratoire, Braquo, exposé dans un article de Sécurité globale. S’appuyant sur des données ouvertes (médias) et sur la connaissance experte, le projet présentait des éléments précieux d’aide à la décision pour la planification de déploiement de patrouilles sur le territoire national.

Récemment, NukkAI et Thales ont commencé à travailler sur un projet commun de fusion de données hétérogènes, dans le champ du renseignement. Cette fois, la connaissance experte d’un général de l’OTAN guide les recherches de l’algorithme de NukkAi, qui, dans un amas de données ouvertes et fermées, recherche des éléments pas toujours dans la même langue, ou ne désigne pas les objets similaires du même nom. Puis l’IA procède à des déductions et envoie à l’analyste une recommandation de changement de niveau d’alerte, assortie d’une description des éléments justifiant cette recommandation.

Actuellement testé dans un exercice OTAN, cet outil permettrait de rendre beaucoup plus efficaces les analystes des centres de commandement. Dans un futur proche, il intègrera un large language model souverain pour aider les interactions humain-machine, les performances de « l’analyste augmenté » s’en trouvant encore nettement améliorées.

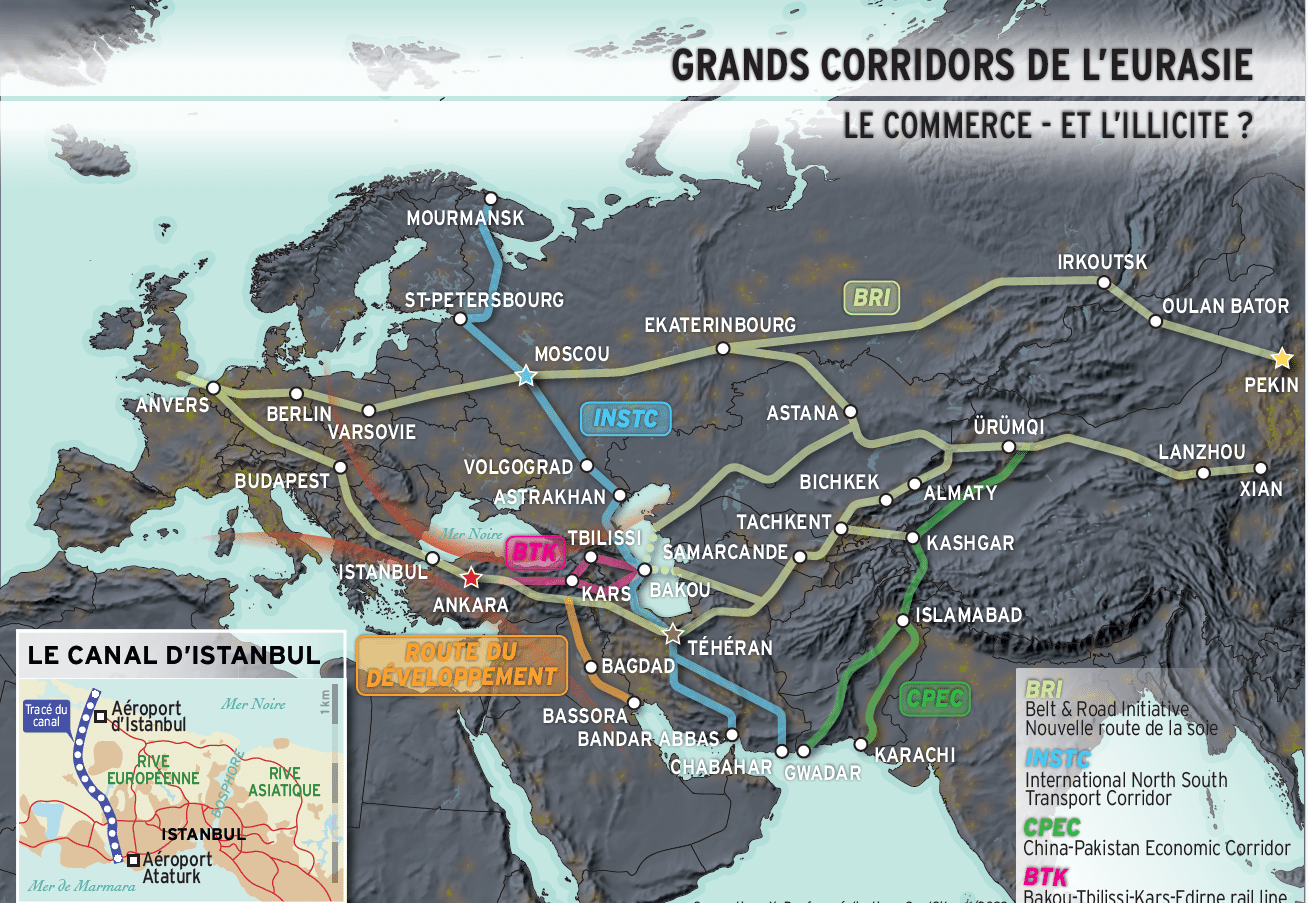

Cet outil constitue une première brique importante, premier démonstrateur du potentiel du couple humain-IA dans le domaine du renseignement. Il saura demain repérer des « patterns » dans les données réelles ou d’exercice, d’en extraire des règles compréhensibles par l’humain, de les proposer à l’analyste, pour affiner la connaissance experte dans un système de boucle vertueuse d’interaction humain-machine. Lors de la conférence du 30 novembre 2023 au CNAM, divers intervenants de haute qualité sont intervenus, proposant des scénarios géopolitiques, dessinant des cartes de flux et corridors de transport de marchandises, légales ou non, etc. Cette connaissance pose un cadre qui peut aider à guider la machine, l’aider à « se concentrer sur l’essentiel » : on est à l’opposé de la conception de la machine autonome.

A lire aussi

Vladimir Poutine a dit « celui qui maîtrisera l’IA dominera le monde » et contrairement à ce que d’aucuns voudraient nous faire croire, la course est loin d’être terminée. Encore plus dans des domaines stratégiques comme la sécurité et la défense.

Par ailleurs, existent en France des acteurs élaborant des IA différentes, pouvant apporter des réponses au défi de l’anticipation. Ces start-up, grands groupes et experts, collaborent déjà pour proposer des solutions rapides et opérationnelles aux problèmes rencontrés par les acteurs de terrain. Leur succès dépendra du facteur temps et de la capacité de nos pouvoirs publics à se mobiliser dans des délais n’ayant rien à voir avec la temporalité des programmes classiques du monde de la défense.

Encadré

Les textes de Jean-Baptiste Fantin et Xavier Raufer sont issus du colloque « Horizon 2030 : Détecter, Démontrer, Décider » qui s’est tenu au Conservatoire national des arts et métiers (CNAM), le 30 novembre 2023.

Dans un monde surinformé mais désinformé, penser la sécurité, c’est parer aux chocs stratégiques. D’où le crucial besoin d’un renseignement d’alerte pour voir devant nous sur la route du réel observable, réduire l’erreur décisionnelle et repérer à temps les menaces (entités, flux, territoires, situations).

Dirigeants (militaires, renseignement, sécurité), stratèges politiques ou d’entreprises : face aux nouveaux périls, mais aussi aux illusions et impasses, ce colloque a ouvert une réflexion collective et concrète sur le rôle crucial des intelligences artificielles en matière de prévision, de décèlement précoce et de prévention.